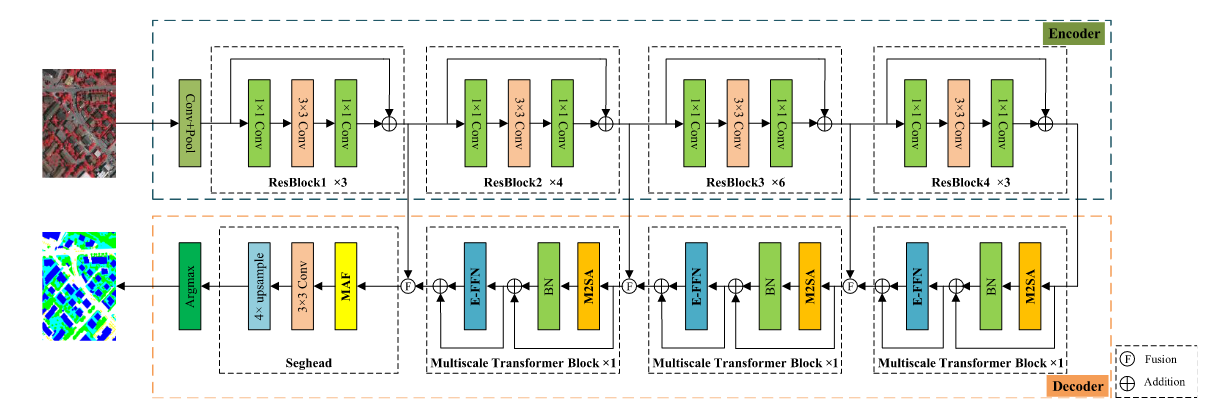

CMTFNet-卷积与多尺度Transformer融合网络在遥感图像语义分割的应用

CMTFNet

卷积神经网络提取局部信息能力强大,但缺乏全局信息的利用。本网络采用encoder-decoder结构,使用多尺度注意力构建Transformer-decoder,增强全局特征的提取。

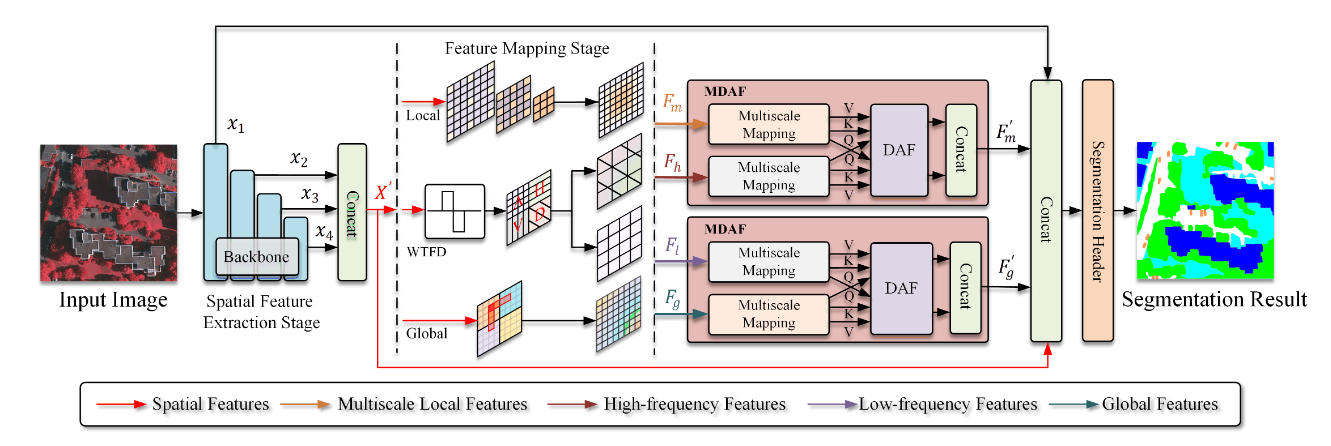

网络结构

编码器

编码器部分采用ResNet50结构作为主体,经过4层主体不断降维,之后将语义特征送入解码器中,在解码器中将ResBlock的特征与经过MTF模块处理后的特征进行权重融合。

解码器

解码器由三级多尺度Transformer块和语义头组成。

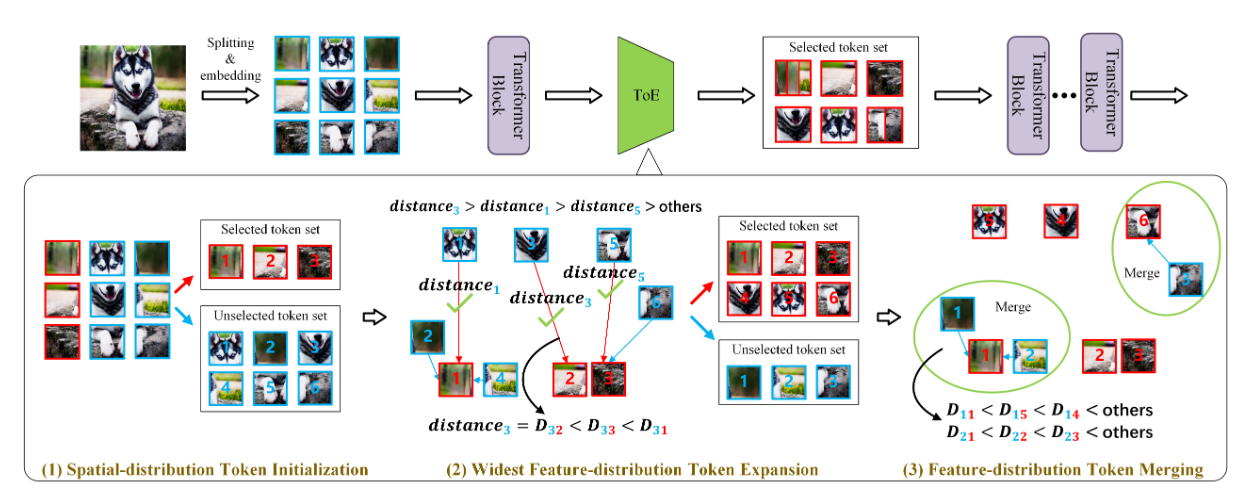

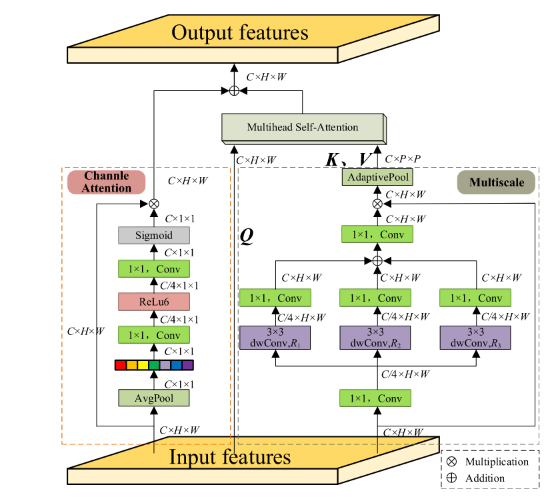

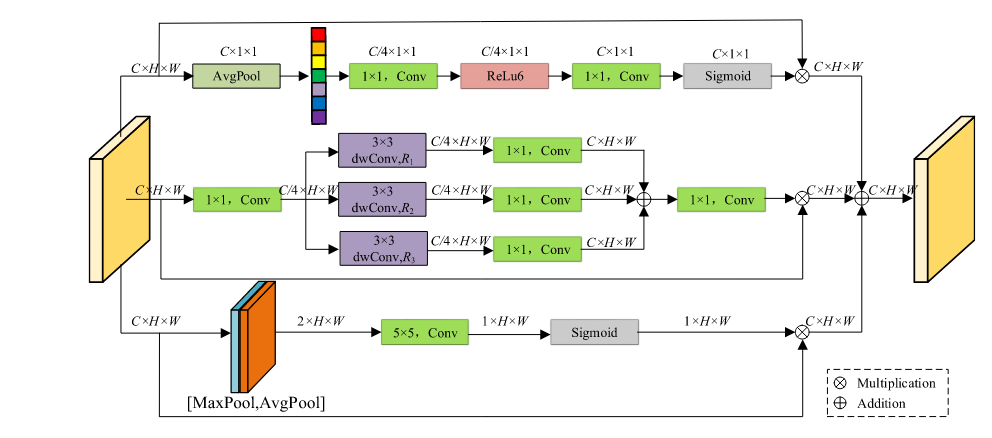

M2SA模块

M2SA模块结合了通道注意力机制,多尺度特征机制,多尺度自注意力机制。

采用了双分支结构来提取全局特征和通道信息。

多注意力尺度分支经过1x1卷积降维后,分别进入三个空洞卷积中进行特征提取,之后将三分支的特征相加融合,最后使用1x1卷积结果和残差连接。之后进行多头注意力计算。

在另一分支中,首先进行平均池化操作降维,之后卷积降低通道数,经过Relu6和卷积升维后使用sigmoid函数得到每个通道的注意力得分,最后与原始输入特征相乘得到数据特征。

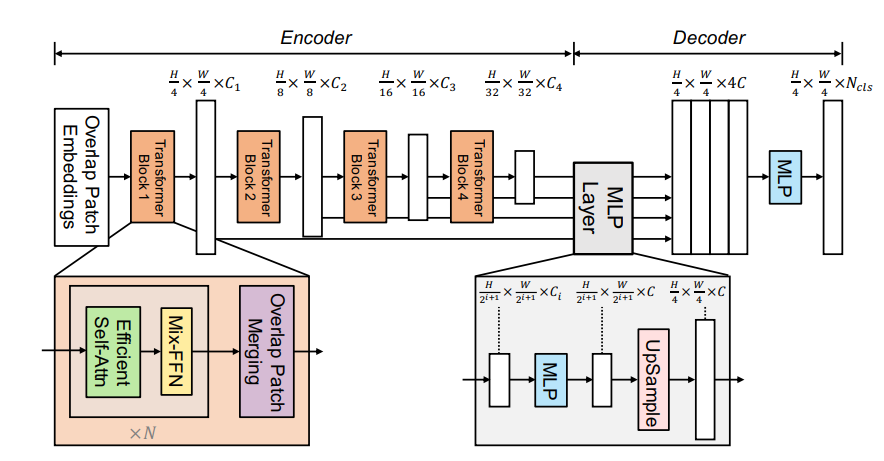

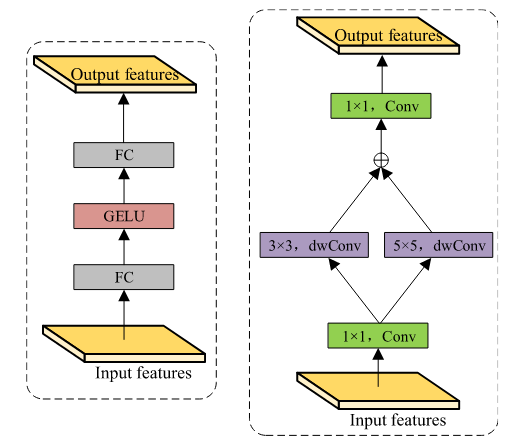

E-FFN模块

与传统的FFN相比,E-FFN采用了1x1卷积操作来替代了原本的两个FC层进行的升维降维操作,以期学到更抽象的特征。并在两个FC层间使用了两个卷积操作替代GELU激活函数,目的是为了进一步地学习图像局部特征。

MAF模块

该模块位于最后得seghead模块的第一部分,ResBlock1块中的特征包含了丰富的图像空间信息。Mutiscale Transformer Blcok有着丰富的语义信息。MAF的目的在于利用好这两部分权重融合后的特征信息。

MAF模块使用了三分支结构来充分表征空间,通道和多尺度信息。

最上方分支利用通道注意力机制,与M2SA中的处理方法相同。

中间分支采用了M2SA模块中多尺度特征提取的处理方法。

最下方的空间特征提取分支在通道维度上分别采用最大池化和平均池化后,在通道维度上将空间特征连接,之后经过卷积提取和sigmoid激活。

最后的特征矩阵由三分支加法融合得到。